(Source:wccftech)

NVIDIAは本日、HPCユーザー向けに2倍のメモリとより高速な帯域幅を備えた最新のA100 PCIe GPUアクセラレータを組み込んだ新しいHGXA100システムの発売を発表しました。

NVIDIAは、フラッグシップアンペアベースのA100 HPCGPUアクセラレータを備えたHGXA100システムをアップグレードし、80GB HBM2eメモリと2TB/s帯域幅

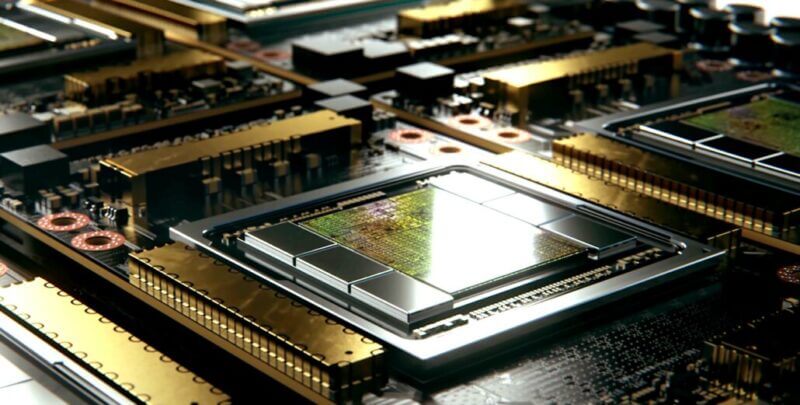

既存のNVIDIAA100 HPCアクセラレータは昨年6月に導入され、グリーンチームはそれにメジャースペックアップグレードを与えることを計画しているようです。このチップは、NVIDIA最大のAmpere GPUであるA100をベースにしており、サイズは826mm2で、540億個の非常識なトランジスタを搭載しています。NVIDIAは、サイクルの途中でHPCアクセラレータにスペックブーストを提供します。これは、GTC2022で次世代アクセラレータについて聞くことを意味します。

NVIDIA A100 Tensor Core GPUは、これまでにないHPCアクセラレーションを提供して、産業用HPCに関連する複雑なAI、データ分析、モデルトレーニング、シミュレーションの課題を解決します。A100 80GB PCIe GPUは、GPUメモリ帯域幅をA100 40GBと比較して25%増加して2TB/sにし、80GBのHBM2e高帯域幅メモリを提供します。

A100 80GB PCIeの巨大なメモリ容量と高いメモリ帯域幅により、より多くのデータとより大きなニューラルネットワークをメモリに保持できるため、ノード間の通信とエネルギー消費を最小限に抑えることができます。より高速なメモリ帯域幅と組み合わせることで、研究者はより高いスループットとより高速な結果を達成し、IT投資の価値を最大化することができます。

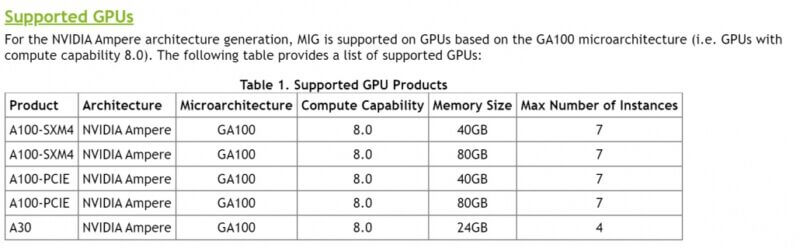

A100 80GB PCIeは、マルチインスタンスGPU(MIG)テクノロジーを搭載したNVIDIA Ampereアーキテクチャを搭載しており、AI推論などの小規模なワークロードに高速化を実現します。MIGを使用すると、HPCシステムは、保証されたサービス品質でコンピューティングとメモリを縮小できます。PCIeに加えて、4ウェイおよび8ウェイのNVIDIA HGXA100構成があります。

A100 80GB PCIeのNVIDIAパートナーサポートには、Atos、Cisco、Dell Technologies、Fujitsu、H3C、HPE、Inspur、Lenovo、 Penguin Computing、QCT、 Supermicroが含まれます。NV Linkを介して相互接続されたA100ベースのGPUを備えたHGXプラットフォームは、Amazon Web Services、Microsoft Azure、およびOracle Cloud Infrastructureのクラウドサービスを介して利用することもできます 。

仕様に関しては、A100 PCIe GPUアクセラレータはコア構成に関してあまり変更されていません。GA100 GPUは、108SMユニットに配置された6912CUDAコア、432 Tensorコア、および1.55 TB/sと比較して2.0TB/sの高い帯域幅を提供する80GBのHBM2eメモリを備えた250W製品で見られた仕様を保持しています。

A featured image of the NVIDIA GA100 die.

A100SMXにはすでに80GBのメモリが付属していますが、この次期A100 PCIeのように高速なHBM2eダイを備えていません。これは、PCIeベースのグラフィックスカードでこれまでに搭載されたメモリの最大量でもありますが、消費者向けグラフィックスカードがすぐにそのような大容量を搭載することは期待できません。興味深いのは、電力定格が変更されていないことです。つまり、高性能のユースケース向けにビニングされた高密度チップを検討しています。

Specifications of the A100 PCIe 80 GB graphics card as listed over at NVIDIA’s webpage. (Image Credits: Videocardz)

FP64のパフォーマンスは引き続き9.7 / 19.5 TFLOP、FP32のパフォーマンスは19.5 / 156/312 TFLOP(スパース)、FP16のパフォーマンスは312/624 TFLOP(スパース)、INT8は624/1248 TOP(スパース)と評価されています。スパース性)。NVIDIAは来週最新のHPCアクセラレータをリリースする予定であり、40 GBのA100が約USD$15,000で販売されていることを考えると、USD$20,000を超える価格も予想されます。

これらの発表に加えて、NVIDIAは新しいInfiniBandソリューションも発表しました。これは、最大2048ポイントのNDR 400 Gb/s(またはNDR 200の4096ポート)の構成を提供し、合計双方向スループットは1.64 Pb/sです。それだけでも前世代の5倍の増加であり、32倍高いAIアクセラレータを提供します。

NVIDIA Ampere GA100 GPU Based Tesla A100 Specs

| NVIDIA Tesla Graphics Card | Tesla K40 (PCI-Express) | Tesla M40 (PCI-Express) | Tesla P100 (PCI-Express) | Tesla P100 (SXM2) | Tesla V100 (SXM2) | Tesla V100S (PCIe) | NVIDIA A100 (SXM4) | NVIDIA A100 (PCIe4) |

|---|---|---|---|---|---|---|---|---|

| GPU | GK110 (Kepler) | GM200 (Maxwell) | GP100 (Pascal) | GP100 (Pascal) | GV100 (Volta) | GV100 (Volta) | GA100 (Ampere) | GA100 (Ampere) |

| Process Node | 28nm | 28nm | 16nm | 16nm | 12nm | 12nm | 7nm | 7nm |

| Transistors | 7.1 Billion | 8 Billion | 15.3 Billion | 15.3 Billion | 21.1 Billion | 21.1 Billion | 54.2 Billion | 54.2 Billion |

| GPU Die Size | 551 mm2 | 601 mm2 | 610 mm2 | 610 mm2 | 815mm2 | 815mm2 | 826mm2 | 826mm2 |

| SMs | 15 | 24 | 56 | 56 | 80 | 80 | 108 | 108 |

| TPCs | 15 | 24 | 28 | 28 | 40 | 40 | 54 | 54 |

| FP32 CUDA Cores Per SM | 192 | 128 | 64 | 64 | 64 | 64 | 64 | 64 |

| FP64 CUDA Cores / SM | 64 | 4 | 32 | 32 | 32 | 32 | 32 | 32 |

| FP32 CUDA Cores | 2880 | 3072 | 3584 | 3584 | 5120 | 5120 | 6912 | 6912 |

| FP64 CUDA Cores | 960 | 96 | 1792 | 1792 | 2560 | 2560 | 3456 | 3456 |

| Tensor Cores | N/A | N/A | N/A | N/A | 640 | 640 | 432 | 432 |

| Texture Units | 240 | 192 | 224 | 224 | 320 | 320 | 432 | 432 |

| Boost Clock | 875 MHz | 1114 MHz | 1329MHz | 1480 MHz | 1530 MHz | 1601 MHz | 1410 MHz | 1410 MHz |

| TOPs (DNN/AI) | N/A | N/A | N/A | N/A | 125 TOPs | 130 TOPs | 1248 TOPs 2496 TOPs with Sparsity | 1248 TOPs 2496 TOPs with Sparsity |

| FP16 Compute | N/A | N/A | 18.7 TFLOPs | 21.2 TFLOPs | 30.4 TFLOPs | 32.8 TFLOPs | 312 TFLOPs 624 TFLOPs with Sparsity | 312 TFLOPs 624 TFLOPs with Sparsity |

| FP32 Compute | 5.04 TFLOPs | 6.8 TFLOPs | 10.0 TFLOPs | 10.6 TFLOPs | 15.7 TFLOPs | 16.4 TFLOPs | 156 TFLOPs (19.5 TFLOPs standard) | 156 TFLOPs (19.5 TFLOPs standard) |

| FP64 Compute | 1.68 TFLOPs | 0.2 TFLOPs | 4.7 TFLOPs | 5.30 TFLOPs | 7.80 TFLOPs | 8.2 TFLOPs | 19.5 TFLOPs (9.7 TFLOPs standard) | 19.5 TFLOPs (9.7 TFLOPs standard) |

| Memory Interface | 384-bit GDDR5 | 384-bit GDDR5 | 4096-bit HBM2 | 4096-bit HBM2 | 4096-bit HBM2 | 4096-bit HBM2 | 6144-bit HBM2e | 6144-bit HBM2e |

| Memory Size | 12 GB GDDR5 @ 288 GB/s | 24 GB GDDR5 @ 288 GB/s | 16 GB HBM2 @ 732 GB/s 12 GB HBM2 @ 549 GB/s | 16 GB HBM2 @ 732 GB/s | 16 GB HBM2 @ 900 GB/s | 16 GB HBM2 @ 1134 GB/s | Up To 40 GB HBM2 @ 1.6 TB/s Up To 80 GB HBM2 @ 1.6 TB/s | Up To 40 GB HBM2 @ 1.6 TB/s Up To 80 GB HBM2 @ 2.0 TB/s |

| L2 Cache Size | 1536 KB | 3072 KB | 4096 KB | 4096 KB | 6144 KB | 6144 KB | 40960 KB | 40960 KB |

| TDP | 235W | 250W | 250W | 300W | 300W | 250W | 400W | 250W |

NVIDIA A100 Tensor Core GPUは、これまでにないHPCアクセラレーションを提供して、産業用HPCに関連する複雑なAI、データ分析、モデルトレーニング、シミュレーションの課題を解決します。A100 80GB PCIe GPUは、GPUメモリ帯域幅をA100 40GBと比較して25%増加して2TB/sにし、80GBのHBM2e高帯域幅メモリを提供します。

NVIDIA A100 Tensor Core GPUは、これまでにないHPCアクセラレーションを提供して、産業用HPCに関連する複雑なAI、データ分析、モデルトレーニング、シミュレーションの課題を解決します。A100 80GB PCIe GPUは、GPUメモリ帯域幅をA100 40GBと比較して25%増加して2TB/sにし、80GBのHBM2e高帯域幅メモリを提供します。